Un altro modello AI si è unito al mare dei modelli AI e questo è di nuovo di OpenAI. OpenAI ha precedentemente rilasciato GPT-4o quest’anno, che avrebbe dovuto essere più efficiente di GPT-4. Ma era comunque piuttosto costoso e poteva accumulare una bella bolletta, specialmente per gli sviluppatori che hanno bisogno di chiamare il modello AI tramite l’API per le loro app ripetutamente durante il giorno.

Di conseguenza, gli sviluppatori si sono rivolti a modelli di intelligenza artificiale più economici e di piccole dimensioni offerti dalla concorrenza, come Gemini 1.5 Flash o Claude 3 Haiku.

Ora, OpenAI sta rilasciando GPT-4o mini, il loro modello più conveniente finora, con cui stanno anche entrando nel piccolo spazio dei modelli AI. Mentre GPT-4o mini è il loro modello più economico finora, non sta ottenendo quel basso costo tagliando l’intelligenza; è più intelligente del loro attuale modello GPT-3.5 Turbo.

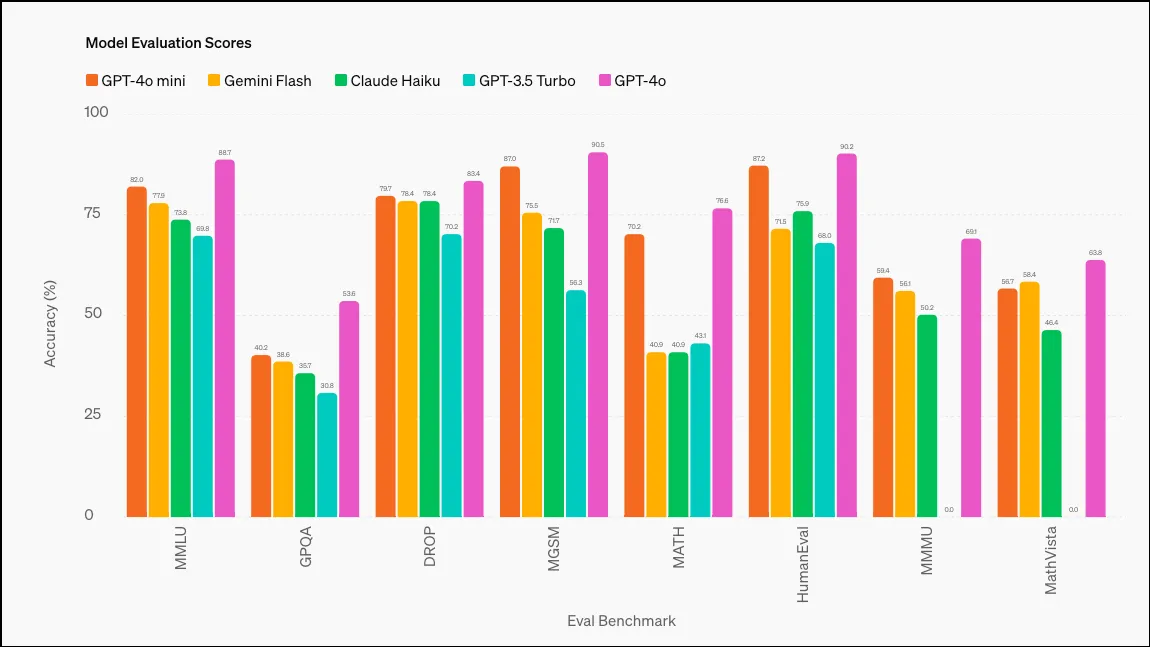

Secondo OpenAI, GPT-4o mini ha ottenuto l’82% in MMLU (Measuring Massive Multitask Language Understanding), superando molti modelli; questi sono i punteggi rispettivi di diversi modelli: GPT-3.5 Turbo (70%), Claude 3 Haiku (75,2%) e Gemini 1.5 Flash (78,9%). GPT-4o ha ottenuto l’88,7% in questo benchmark, con Gemini Ultra che vanta il punteggio più alto: il 90% (questi non sono piccoli modelli di intelligenza artificiale, però).

GPT-4o mini è in fase di distribuzione per gli utenti ChatGPT Free, Team e Plus, nonché per gli sviluppatori, oggi. Per gli utenti ChatGPT, ha sostanzialmente sostituito GPT-3.5; GPT-4o mini sarà il modello predefinito della conversazione una volta esaurite le query GPT-4o gratuite. Gli sviluppatori avranno ancora la possibilità di utilizzare GPT-3.5 tramite l’API, ma alla fine verrà eliminato. Gli utenti ChatGPT Enterprise avranno accesso a GPT-4o mini la prossima settimana.

Come accennato in precedenza, l’obiettivo di GPT-4o mini è aiutare gli sviluppatori a trovare un modello a basso costo e latenza per la loro app che sia anche capace. Rispetto ad altri piccoli modelli, GPT-4o mini eccelle nelle attività di ragionamento sia in testo che in visione, nel ragionamento matematico e nelle attività di codifica, nonché nel ragionamento multimodale.

Attualmente supporta sia testo che visione nell’API, con supporto per input e output di testo, immagini, video e audio nella roadmap per il futuro.

GPT-4o mini ha una finestra di contesto di 128K token per l’input e 16K token per l’output per richiesta, con la sua conoscenza che arriva fino a ottobre 2023. Può anche gestire testo non inglese in modo piuttosto conveniente.

Lascia un commento