Apple ha introdotto una nuova funzionalità AI nota come Visual Intelligence, che verrà lanciata con l’imminente aggiornamento iOS 18.2. La nostra esperienza pratica con l’ultima beta rivela una serie di entusiasmanti funzionalità. Visual Intelligence trasforma la tua fotocamera in uno strumento sofisticato, guidato dall’intelligenza artificiale, simile a Google Lens.

Cos’è esattamente l’intelligenza visiva?

Mentre Siri funge da intelligenza artificiale interattiva tramite comandi vocali per rispondere alle tue richieste, Visual Intelligence agisce come un’intelligenza artificiale incentrata sulla vista, consentendoti di puntare la fotocamera su vari oggetti per raccogliere informazioni o eseguire rapidamente attività.

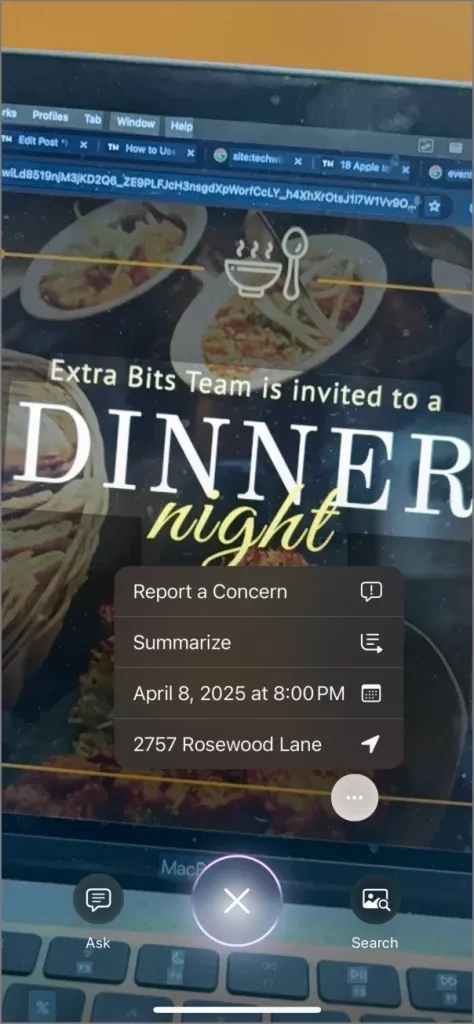

Ad esempio, indirizzare il tuo iPhone verso un locale di ristorazione può rivelare le sue valutazioni e gli orari estratti direttamente da Apple Maps, e potrebbe persino mostrare il loro menu. Quando scansioni un volantino di un evento, può automaticamente suggerirti le opzioni per aggiungere l’evento al tuo Calendario o ottenere indicazioni stradali per raggiungere il locale, eliminando la necessità di immissione manuale dei dati.

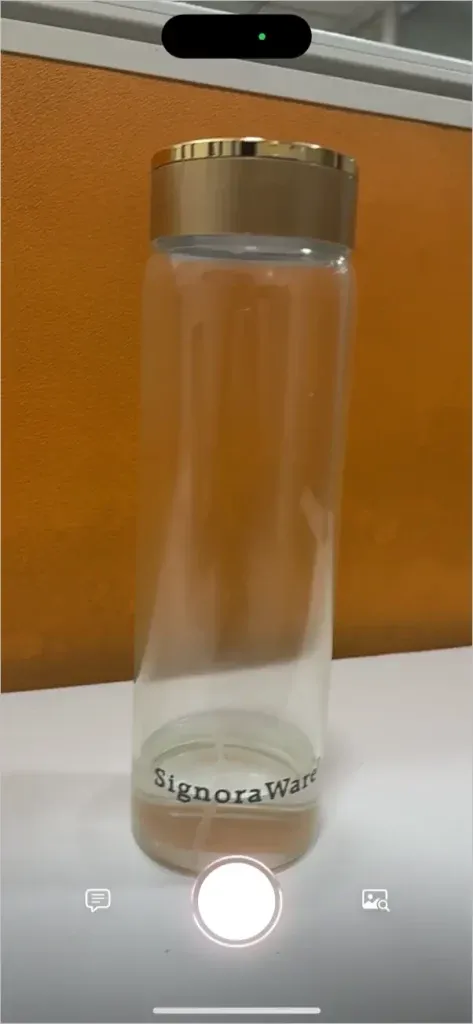

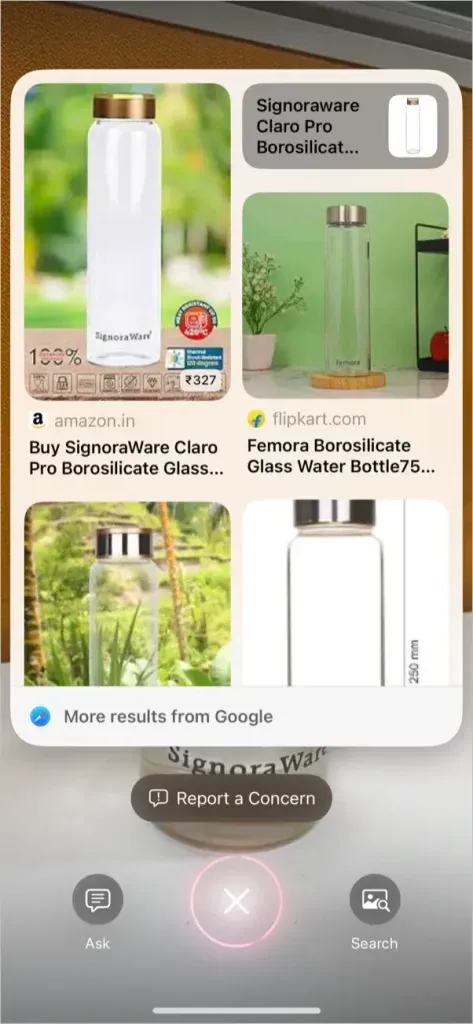

Basta puntare la fotocamera su un qualsiasi oggetto per recuperare informazioni tramite ChatGPT o per trovare immagini simili tramite Google. Ciò significa che puoi identificare la razza di un animale o di una pianta o persino scoprire dove acquistare un prodotto online.

Considerate Visual Intelligence come un’iterazione altamente integrata di Google Lens con miglioramenti distinti da Apple. Questa funzionalità, tuttavia, è limitata alla serie iPhone 16, che utilizza le capacità del chip A18.

Come attivare l’intelligenza visiva

Puoi accedere a Visual Intelligence senza problemi tramite la funzionalità Camera Control su iPhone 16. Fa parte dell’aggiornamento iOS 18.2, che è attualmente nella sua prima beta per sviluppatori e si prevede che sarà disponibile al pubblico entro la fine dell’anno. Per iniziare, passa al canale beta per l’aggiornamento iOS 18.2 o attendi la versione stabile.

- Tieni premuto a lungo il nuovo pulsante Controllo fotocamera per visualizzare un’interfaccia simile al mirino di una fotocamera, completa di opzioni di anteprima e di acquisizione.

- Una volta attivato, punta la fotocamera sull’oggetto di cui vuoi avere informazioni e premi il pulsante di acquisizione per avviare Visual Intelligence.

- Qualunque sia l’argomento, vedrai sempre due scelte: Chiedi e Cerca .

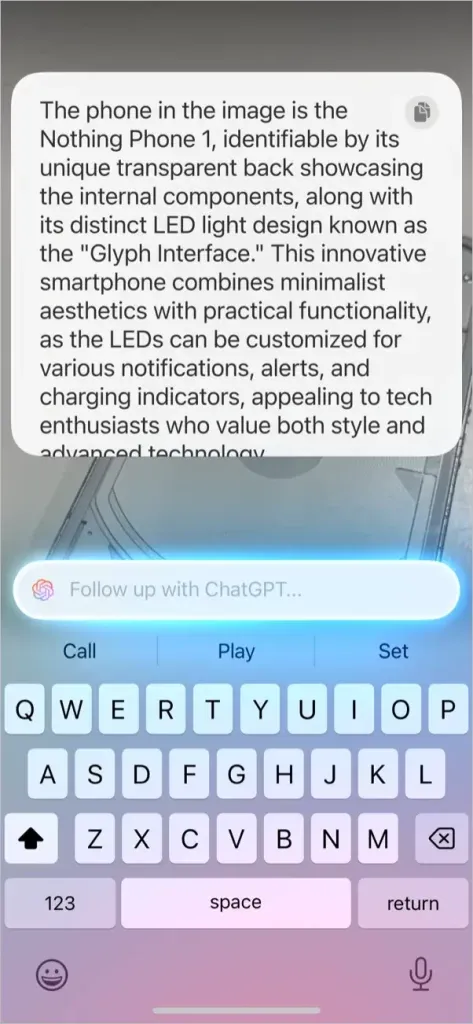

- Chiedi : invia l’immagine a ChatGPT per avviare una conversazione e scoprire di più.

- Ricerca : utilizza Google per trovare immagini simili o link per acquistare articoli correlati online.

Utilizzare l’intelligenza visiva nella routine quotidiana

- Punta il tuo iPhone su un punto di riferimento per scoprirne il nome, il contesto storico, gli orari di visita e i servizi nelle vicinanze.

- Utilizza la fotocamera del tuo iPhone sulla copertina di un libro o su un prodotto e applica la funzione di ricerca per trovare recensioni, opzioni di acquisto e altro ancora.

- Punta il telefono verso una pianta o un animale e sfrutta la funzione Chiedi o Cerca per identificare la specie, oltre ad avere informazioni aggiuntive come l’habitat, le caratteristiche della specie o suggerimenti per la cura.

- Punta la tua fotocamera sul poster di un evento e Visual Intelligence estrarrà il nome dell’evento, l’orario, la data e il luogo, con la possibilità di aggiungerli direttamente al tuo calendario .

- Se ti imbatti in un testo molto lungo, ti basta inquadrarlo con la fotocamera per ottenere un breve riepilogo, oppure lasciare che ChatGPT lo spieghi in un linguaggio più semplice.

Sebbene Visual Intelligence sia uno strumento incredibilmente utile, presenta alcune limitazioni. Ad esempio, a differenza di Google Lens, al momento non dispone di un’opzione di registrazione video che consenta ricerche live di soggetti di grandi dimensioni. Speriamo che i futuri aggiornamenti affrontino questa funzionalità.

31 funzionalità nascoste di iOS 18 che devi controllare

Lascia un commento