Alla sua conferenza annuale I/O in California, Google ha fatto diversi annunci relativi all’intelligenza artificiale, inclusi nuovi modelli e aggiornamenti a quelli esistenti. Uno degli annunci più interessanti è stato Project Astra, un assistente multimodale che funziona in tempo reale e combina le capacità di Google Lens e Gemini per fornirti informazioni dall’ambiente circostante.

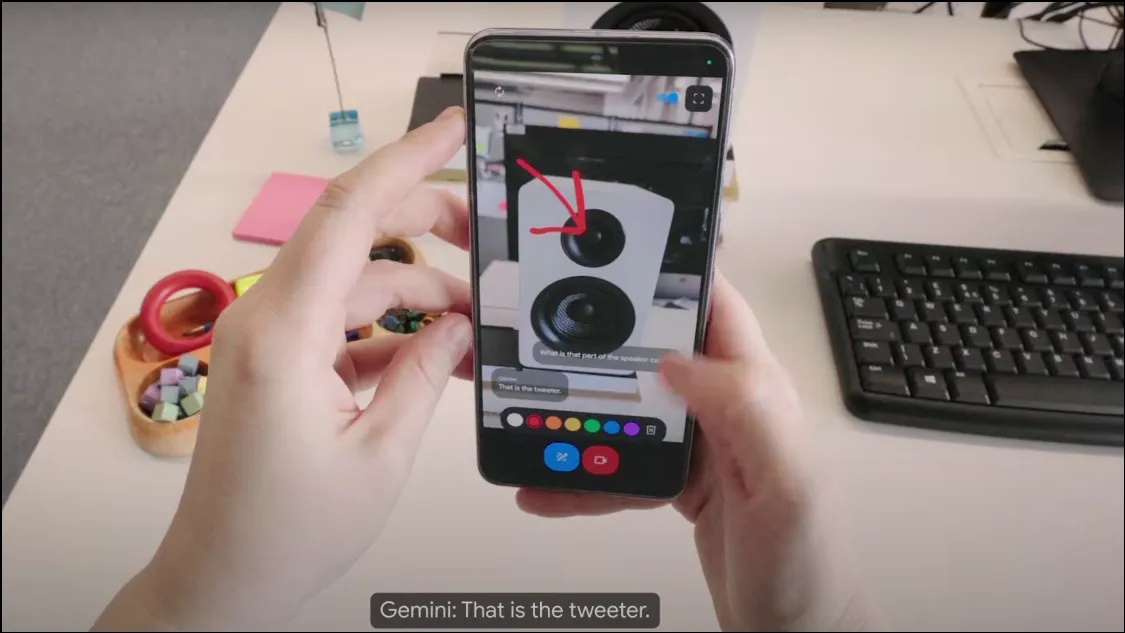

Come funziona il progetto Astra? Alla conferenza, Google ha mostrato una prima versione di Project Astra, che funziona come un chatbot basato su fotocamera e può raccogliere informazioni dall’ambiente circostante utilizzando la fotocamera del tuo dispositivo. Essendo un assistente AI multimodale, può utilizzare audio, video e immagini come input e fornire l’output necessario in base a questi. Funziona sul modello Gemini 1.5 Pro, che lo rende incredibilmente potente.

Il chatbot analizza gli oggetti e l’ambiente circostante in tempo reale e può rispondere alle domande molto rapidamente, rendendolo molto simile a un assistente umano o all’amato JARVIS di Tony Stark. Project Astra funziona anche con dispositivi indossabili come gli occhiali intelligenti, il che significa che c’è molto potenziale per integrare il chatbot AI in diversi dispositivi.

Project Astra può comprendere meglio il contesto in cui viene utilizzato, elaborare le informazioni più velocemente e conservarle per un recupero più rapido. Anche le sue capacità vocali sono molto migliorate rispetto a quelle dei precedenti modelli Gemini, quindi suona più naturale e simile a quello umano.

Cosa può fare il progetto Astra? Nella breve demo mostrata da Google, sembra che Project Astra possa aiutare a realizzare molto. Può osservare e comprendere oggetti e posizioni attraverso l’obiettivo della fotocamera e il microfono e fornire informazioni su di essi. Ad esempio, puoi semplicemente puntare il telefono verso un pezzo di codice e discuterne con il chatbot, oppure chiedergli di identificare un oggetto e il suo utilizzo.

Allo stesso modo, grazie alle funzionalità di localizzazione, Project Astra può fornire informazioni sulla tua località semplicemente dando un’occhiata all’ambiente circostante. Può anche conservare le informazioni mostrate, il che può essere molto utile se desideri individuare oggetti smarriti, come dimostrato nella demo quando ha aiutato l’utente a trovare i propri occhiali.

Puoi anche chiedere idee creative all’assistente AI, proprio come con Gemini sul tuo telefono. Ad esempio, puoi chiedergli di inventare il testo di una canzone, il nome di un gruppo musicale o qualsiasi altra cosa. Fondamentalmente, Project Astra mira ad essere un assistente AI universale in grado di fornirti informazioni in tempo reale in modo molto colloquiale.

Quando sarà disponibile il progetto Astra? Al momento, Google non ha fatto annunci riguardanti la disponibilità di Project Astra. La versione mostrata nella demo è un prototipo iniziale, ma Google ha lasciato intendere che queste funzionalità potrebbero essere integrate nell’app Gemini esistente in una fase successiva.

Con Project Astra, Google si impegna a guidare l’evoluzione degli assistenti IA affinché diventino ancora più utili e facili da usare. Google, però, non è l’unico a perseguire questo obiettivo. OpenAI ha recentemente annunciato anche GPT-4o, rendendo multimodale il suo ChatGPT, migliorandone le capacità e l’efficienza. La nuova modalità vocale di ChatGPT (che sarà rilasciata a breve) può anche utilizzare l’input video dalla fotocamera del dispositivo mentre interagisce con gli utenti.

Al momento, la differenza tra i due è che GPT-4o sarà presto disponibile su tutti i dispositivi che eseguono ChatGPT, mentre Project Astra dovrebbe essere disponibile come Gemini Live in futuro, anche se al momento non esiste una data di rilascio. Con ChatGPT basato su GPT-4o disponibile in precedenza, resta da vedere se Project Astra di Google sarà abbastanza buono da rivaleggiare con il più popolare chatbot di OpenAI.

Lascia un commento